08 abril 2026

08 abril 2026

Se você é estudante e já usou o ChatGPT para montar um trabalho ou rascunhar uma redação, não está sozinho. A prática virou rotina nas universidades e escolas de todo o Brasil — inclusive aqui em Botucatu. O problema é que, ao mesmo tempo em que os alunos adotaram a ferramenta, as instituições de ensino passaram a adotar detectores de IA.

A questão não é mais “dá pra usar IA?” — é “o que acontece quando o professor usa um detector e seu texto aparece como 80% gerado por máquina?”

O que são os detectores de IA e como funcionam

Detectores de IA são ferramentas treinadas para identificar padrões típicos de escrita automatizada: ritmo de frase muito uniforme, transições padronizadas entre parágrafos, vocabulário “seguro” demais, ausência de variação natural no texto.

Modelos como ChatGPT, Gemini e outros LLMs produzem textos com uma regularidade que é fácil de identificar quando você sabe o que procurar. E os detectores sabem. Eles não leem significado — leem padrão.

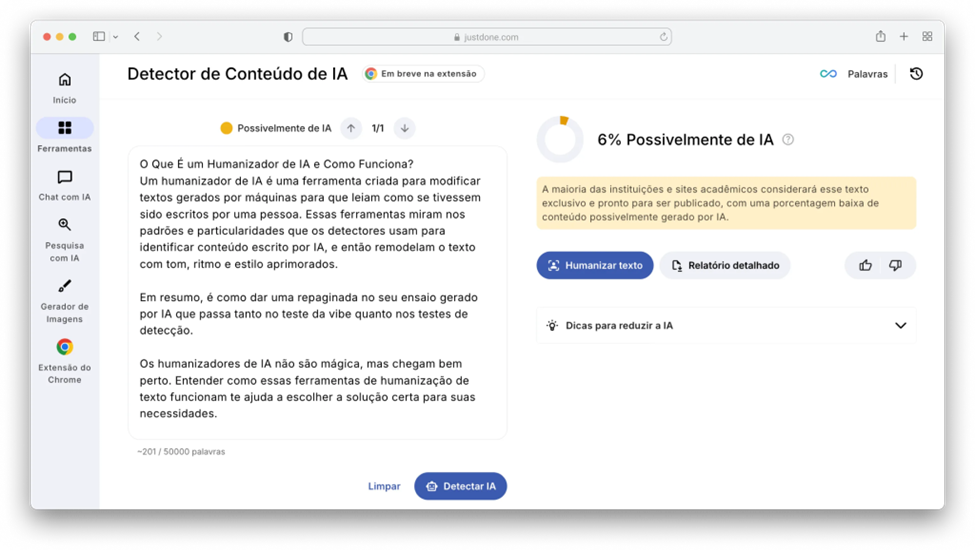

Ferramentas como JustDone AI, GPTZero e Originality.ai já são usadas por professores universitários para triagem de trabalhos acadêmicos. O JustDone, especificamente, usa um sistema de detecção duplo treinado em mais de um milhão de amostras e analisa ritmo, previsibilidade e consistência de formatação — os mesmos sinais que qualquer avaliador experiente perceberia ao ler com atenção.

Isso não significa que todo texto marcado como “IA” vai resultar em punição automática. Mas significa que você pode ser chamado a explicar o seu trabalho — e que a margem para isso está diminuindo.

O que está mudando nas instituições de Botucatu

A Universidade Estadual Paulista (Unesp), que tem campus em Botucatu, assim como a Faculdade de Medicina de Botucatu e outras instituições da região, estão em processo de atualização das suas políticas sobre uso de IA. Não existe ainda uma regra uniforme no ensino superior brasileiro, mas a tendência é clara: o uso não declarado de IA em trabalhos acadêmicos está sendo enquadrado como conduta similar ao plágio em muitas faculdades.

No ensino médio, a situação é parecida. Professores relatam dificuldade em comprovar o uso de IA formalmente, mas o olhar mudou — e textos que chegam “perfeitos demais” já chamam atenção de uma forma que antes não chamavam.

O problema não é usar IA. É usar sem entender o que isso significa para a autoria do que você entrega.

Qual é o risco real para o aluno?

O risco não é só a nota. É a situação de ser questionado sobre um texto que você não consegue defender — porque, no fundo, não é seu.

Isso acontece mais do que se imagina: um aluno entrega um trabalho gerado pelo ChatGPT, o professor pede para explicar oralmente o argumento central, e o estudante não consegue. Não porque seja preguiçoso, mas porque nunca passou pelo processo de pensar sobre o tema. Usou a ferramenta como atalho, não como apoio.

Há uma diferença importante entre usar IA para ajudar a organizar ideias que você já tem, e usar IA para ter ideias que você não teve. No primeiro caso, você ainda é o autor. No segundo, você assinou algo que não construiu.

Como usar IA de forma que não te coloque em risco

A boa notícia é que dá para usar IA no processo de escrita acadêmica de forma inteligente e transparente. O segredo está em manter o controle sobre o que você está entregando.

Uma prática que funciona bem é usar a IA para rascunhar a estrutura — títulos de seção, tópicos centrais, ordenação dos argumentos — e depois escrever o conteúdo com suas próprias palavras, usando o rascunho como guia. Isso preserva seu raciocínio no texto final e torna muito mais fácil defender o trabalho se necessário.

Outra abordagem é usar a IA para pesquisa e síntese de informações — pedir que ela resuma um conceito, explique uma teoria, liste referências — e então reescrever essas informações do seu próprio ponto de vista.

Em ambos os casos, uma revisão antes de entregar faz diferença. Não só gramatical — mas uma verificação de se o texto ainda soa como você.

Por que verificar o próprio texto antes de entregar

Rodar seu próprio trabalho em um detector de IA antes de entregar não é trapaça. É o mesmo que revisar a formatação antes de imprimir ou checar as referências antes de enviar. É parte do processo de entrega responsável.

O JustDone AI, por exemplo, mostra não só um percentual de “detecção” mas também marca quais trechos do texto têm padrões mais mecânicos. Isso te dá a chance de reescrever as partes problemáticas antes que o professor as veja — não para enganar o sistema, mas para garantir que o texto que está sendo entregue representa de fato o seu pensamento.

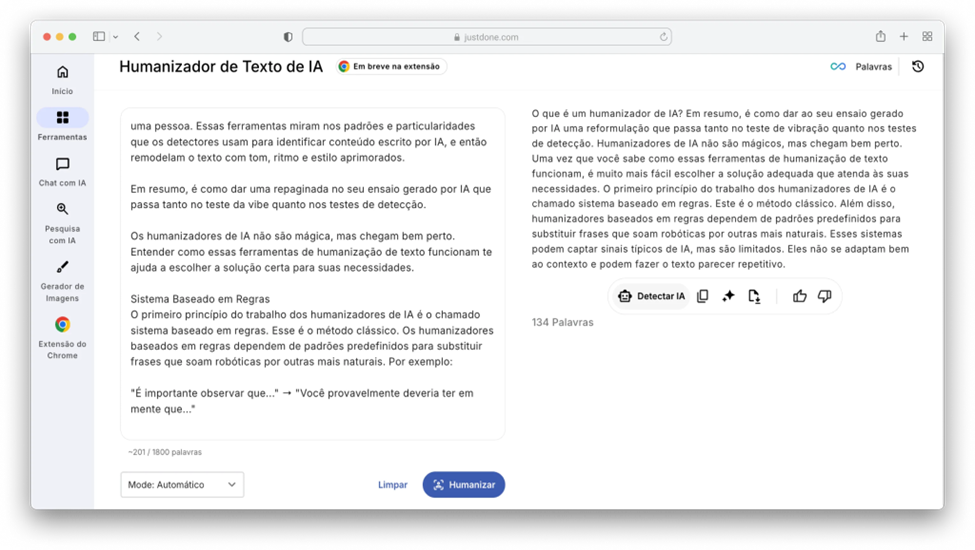

A plataforma também tem um Humanizador, que reescreve trechos identificados como muito “IA” com variações mais naturais, mantendo o conteúdo mas ajustando o ritmo e a estrutura. Para estudantes que usam IA como ponto de partida e precisam garantir que o texto final soe como trabalho humano, essa ferramenta funciona como uma segunda revisão editorial.

O fluxo prático fica assim: você usa IA para ajudar na estrutura ou no rascunho, reescreve com suas palavras, roda o detector para ver onde ainda está mecânico, e reescreve essas partes. O que chega ao professor é um texto que passou pelo seu filtro intelectual — não uma saída bruta de modelo.

O que fazer se o professor questionar seu trabalho

Se você usou IA como apoio e trabalhou o texto depois, você consegue defender o que escreveu. Consegue explicar os argumentos, contextualizar as fontes, mostrar como chegou às conclusões.

Se você entregou um rascunho de IA sem revisão real, a situação é mais difícil — e não existe ferramenta que resolva isso depois do fato.

Muitas faculdades já pedem que o aluno declare quando usou IA no processo. Fazer isso com honestidade — “usei o ChatGPT para estruturar os tópicos e depois desenvolvi o conteúdo” — é uma postura que a maioria dos professores respeita. O que não funciona é negar e ser pego depois.

IA no ensino: nem proibição total, nem carta branca

A discussão no ensino superior brasileiro sobre IA está longe de um consenso. Há professores que proíbem qualquer uso, outros que pedem declaração, e outros que incentivam ativamente desde que o aluno demonstre domínio do conteúdo.

O que está emergindo como posição mais razoável — tanto para instituições quanto para alunos — é tratar a IA como um recurso, não como um atalho. Da mesma forma que a calculadora não eliminou a necessidade de entender matemática, o ChatGPT não elimina a necessidade de entender o que você está escrevendo.

Saber usar IA bem — com consciência, com revisão, com autoria real — pode ser uma habilidade valorizada no mercado de trabalho. Entregar trabalhos que você não consegue defender é só uma forma mais tecnológica de não aprender.

A mudança já chegou. A pergunta agora é como cada aluno vai se posicionar diante dela.

Compartilhe esta notícia